| 澶辨晥閾炬帴澶勭悊 |

|

transformers 鎿嶄綔綃?PDF 涓嬭澆

鐩稿叧鎴浘錛?/strong>

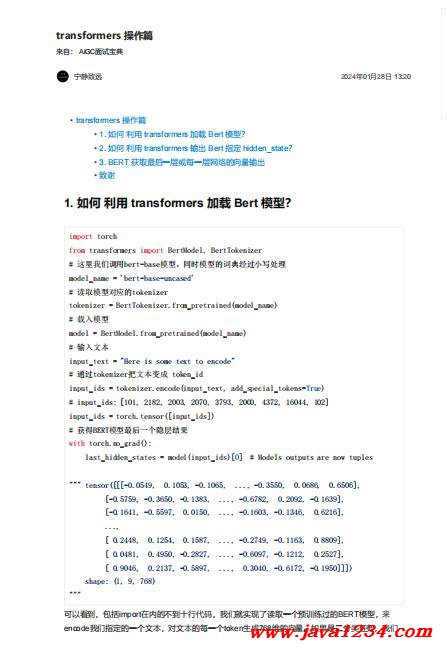

涓昏鍐呭錛?/strong> 1. 濡備綍 鍒╃敤 transformers 鍔犺澆 Bert 妯″瀷錛?/strong>

2. 濡備綍 鍒╃敤 transformers 杈撳嚭 Bert 鎸囧畾 hidden_state錛?/strong>

Bert 榛樿鏄?鍗佷簩灞傦紝浣嗘槸鏈夋椂鍊欓璁粌鏃跺茍涓嶉渶瑕佸埄鐢ㄥ叏閮ㄥ埄鐢紝鑰屽彧闇€瑕侀璁粌鍓嶉潰鍑犲眰鍗?/span>

鍙紝姝ゆ椂璇ユ€庝箞鍋氬憿錛?/span>

涓嬭澆鍒?/span>bert-base-uncased鐨勬ā鍨嬬洰褰曢噷闈㈠寘鍚?閰嶇疆鏂囦歡 config.json, 璇ユ枃浠朵腑鍖呭惈

output_hidden_states錛屽彲浠ュ埄鐢ㄨ鍙傛暟鏉ヨ緗?緙栫爜鍣ㄥ唴闅愯棌灞傚眰鏁?/span>

|

鑻忓叕緗戝畨澶?32061202001004鍙?/p>

鑻忓叕緗戝畨澶?32061202001004鍙?/p>